7月4日,百度AI开发者大会上宣布了全球首款L4级量产自动驾驶巴士“阿波龙”正式量产下线。阿波龙将首先在厂区、园区等限定场景使用,接下来会在北京、雄安、平潭、深圳、碧桂园和日本东京开启商业化运营。然而,业内却存在着不少质疑的声音,L4级别载人自动驾驶车辆是否真的具备了在开放道路上行驶的条件?系统的安全性是否得到保证,L4级别自动驾驶车上路是否存在着安全隐患? 自动驾驶的安全问题再次引起热议。

尽管3月份Uber事件是全球首例自动驾驶撞死行人事,却不是第一起和自动驾驶相关的交通事故。自动驾驶的安全问题一直是公众关注的焦点,一直以来,公众对自动驾驶安全性都存在广泛质疑,一点“风吹草动”都会引起外界的重点关注。

美国汽车协会调查结果显示,任何涉及自动驾驶汽车的事故都可能会动摇用户对自动驾驶汽车的信任。但这些安全事故是否真的由自动驾驶系统导致?根据公开资料,亿欧汽车不完全统计了自2016年至2018年6月期间国际范围内发生的自动驾驶道路交通事故,总计不足10起,如图:

各个自动驾驶安全事故背后,实际上暴露了整个自动驾驶生态圈的大小问题。对于这一系列安全事故,自动驾驶技术的确难辞其咎,但却不是唯一导致事故发生的原因,这些事故中可能还存在其他“帮凶”。统计了自2016年以来自动驾驶汽车发生的交通安全事故,其中L3级别以上的汽车均为测试车,可从表中了解到并不是每一起事故都以自动驾驶车辆为主要过错方。

通过分析几起由自动驾驶车辆承担主要责任的事故,小编发现问题核心主要有以下几点:

1、无论是测试车还是量产车,自动驾驶技术都仍有缺陷,决策系统不完善,无法处理一些意外情况;

2、对于量产车而言,车企夸大宣传量产车的“辅助驾驶系统”,导致用户“辅助驾驶系统”和“完全自动驾驶系统”两者概念混乱,从而误导了用户使用方式;

3、对于测试车而言,车上安全员注意力不集中或者操作失误,导致本就技术不成熟的测试车辆发生事故。

自动驾驶技术仍未成熟,企业难辞其咎

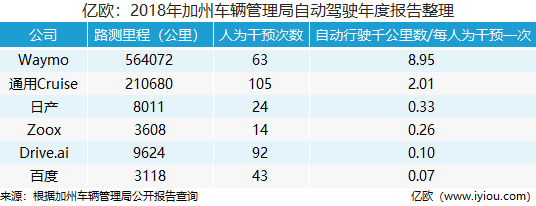

事实上,无人驾驶技术的确离成熟还有一定距离,亿欧汽车从美国加州车辆管理局(Department of Motor Vehicles)2018年发布的自动驾驶年度报告窥探到这一点(特斯拉没有提交数据)。

数据结果显示,目前自动驾驶做的最好的Waymo每行驶8.95千公里也需要进行一次人工干预(若不进行人工干预可能会发生事故),而据美国交通安全部门统计,人类平均驾驶25万公里才会出一次事故。由此可见,目前无人驾驶技术还有很长的一段路要走。无人驾驶的安全问题,尤其是高级别的无人驾驶安全问题,尤其需要重视,群众对无人驾驶安全性的担忧也不无道理。

尽管在绝大部分自动驾驶交通事故中,车企都指出己方并不需要负主要责任,被撞车辆的违规行驶、驾驶员的违规操作才是导致大部分自动驾驶事故的原因,但在部分自动驾驶事故中,车企方面也承认自动驾驶技术的确仍有缺陷。

Uber公司内部表示,2018年3月这起Uber无人车撞死行人事件,可能与Uber自动驾驶系统中负责决定如何对传感器检测到的物体做出反应的软件有关。此前Uber一直试图让自动驾驶车性能与体验更加完善,减少对路况中“假阳性”物体(如飘动的塑料袋)反应,造成系统对汽车周围物体不够“敏感”。

除此之外,Waymo和特斯拉也承认自动驾驶系统不够完善,对路况分析的错误是导致部分安全事故发生的主要原因。

量产车仍停留在“辅助驾驶”阶段,用户概念模糊

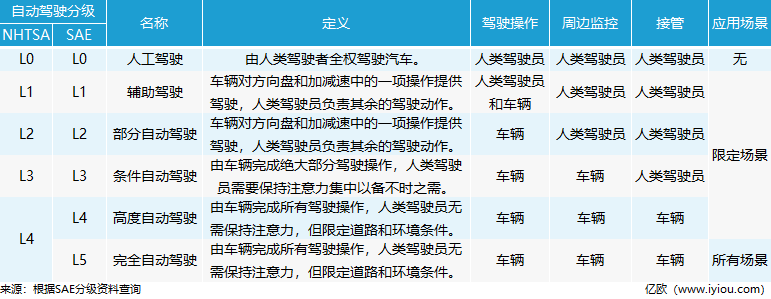

2014年,国际汽车工程师学会(SAEInternational)发布了自动驾驶的六级分类体系。美国国家公路交通安全管理局(NHTSA)于2016年9月开始采用SAE分类标准。目前,SAE已经是自动驾驶研究中的主流分类标准。

SAE标准将自动驾驶技术分为0~6级,可从分级表中看出L1和L2的功能非常有限,需要人类驾驶员负责大部分驾驶,实际上只是一种“辅助驾驶系统”。而现阶段量产车均在L2到L3的过渡阶段,仍需要驾驶员的介入控制,即使达到大部分操作由车辆自动完成的L3级别,也需要人类驾驶员保持注意力集中以备不时之需。

而部分企业对这种“辅助驾驶系统”进行了夸大宣传,误导了用户的使用方式,使驾驶员过于依赖自动驾驶系统, 在事故中出现放弃控制汽车控制权、不关心路况的情况。德国交通部2016年10月曾要求特斯拉汽车停止为其电动汽车的“Autopilot”(自动驾驶)功能做广告,认为这可能暗示司机不需要集中注意力。

从另一个角度讲,即使是高级别的自动驾驶汽车,也仍停留在测试完善阶段。车辆内的安全员起着紧急情况下处理突发问题的责任,由于安全员注意力不集中所导致的事故,是可以避免的。因而,对安全员的行为规范必须要有严格的要求和标准,杜绝此类情况再次发生。

自动驾驶发展任重道远

美国兰德公司(RAND Corporation)2016年曾建立模型预测,当自动驾驶比人类驾驶安全90%时,人们才会相信自动驾驶系统比人类驾驶安全。

关于自动驾驶的负面声音的确一直比正面声音大,一些正面声音甚至会被掩盖、忽视。特斯拉创始人马斯克就曾表态称,媒体只关注特斯拉发生了交通事故,而忽略Autopilot降低交通事故发生概率的积极一面。

自动驾驶的确可以避免很多人为因素(如疲劳驾驶、酒驾等)造成的事故。著名音乐制作人、DJ、特斯拉车主Anton Zaslavsk(艺名Zedd)今年6月1日曾在推特(Twitter)上分享称,特斯拉Autopilot系统曾救了自己一命。Zedd表示,他曾经深夜在高速公路上开车时(autopilot功能开启)睡着了,但特斯拉Autopilot的哔哔响声、并关掉音乐提醒,使他醒了过来。

由于人们对自动驾驶发展的格外关注,几乎每一起自动驾驶事故都会被报道。无论情况是否严重,自动驾驶车辆是否是过错方,相关事故都会给大家对自动驾驶安全问题的态度上添几点焦虑值。

尽管目前自动驾驶技术可以辅助人类驾驶员驾驶,使人为驾驶更安全,但目前该技术还没有达到人类可以不掌控汽车操作权的地步。自动驾驶还有很长的一段路要走,多面、辩证地看待这项技术十分关键。从用户层面来讲,人们对于自动驾驶的认知需要提高,主动了解相关技术,明确“辅助驾驶系统”和“自动驾驶系统”概念以及系统应用的限定场景;既要谨慎看待车企的宣传,客观了解自动驾驶技术实际发展、应用情况,按照系统操作要求驾驶,也不该盲目关注负面新闻而忽视该技术的进步与引领的产业变革。